بخشی از پاورپوینت

--- پاورپوینت شامل تصاویر میباشد ----

اسلاید 1 :

مقدمه

در روشهائی که تاکنون بررسی کردیم، سعی بر این بود که با استفاده از مثالهای آموزشی تابعی پیدا کنیم که بتواند توصیفکننده دادهها باشد.

در روش یادگیری IBL بسادگی فقط مثالها را ذخیره میکنیم و هرگونه تعمیم تا مشاهده مثال جدید به تعویق میافتد. به همین دلیل این روش گاهی روش تنبل یا lazy هم نامیده میشود.

lبا مشاهده مثالهای جدید رابطه آن با نمونههای ذخیره شده بررسی شده و یک مقدار برای تابع هدف آن نسبت داده میشود.

اسلاید 2 :

lروش IBL برای هر نمونه جدید، تقریب جداگانهای از تابع هدف را ایجاد میکند. این تقریب فقط به همسایگی نمونه جدید قابل اعمال بوده و هرگز نمیتواند بر روی فضای تمام نمونهها عمل کند.

lکاربرد این روش هنگامی موثر است که تابع هدف خیلی پیچیده بوده ولی در عین حال قابل نمایش توسط توابع سادهتر محلی باشد.

اسلاید 3 :

مشخصهها

lاین روش دارای 3 مشخصه اصلی است:

.1تابع شباهت: مشخص میکند که دو نمونه چقدر نزدیک به هم هستند.انتخاب این تابع میتواند بسیار مشکل باشد. مثلا چگونه میتوان شباهت رنگ موی 2 نفر را بیان نمود؟

.2انتخاب نمونهها برای ذخیره: در این الگوریتم سعی میشود نمونههائی ذخیره شوند که عمومیتر باشند. تشخیص اینکه آیا یک نمونه عمومیت دارد یا خیر، میتواند کار مشکلی باشد.

.3تابع دستهبندیکننده: تابعی است که بامشاهده یک مثال دستهبندی آنرا تعیین میکند.

اسلاید 4 :

مشکلات

lدستهبندی داده جدید میتواند بسیار پرهزینه باشد. زیرا در مرحله آموزش عملی صورت نمیپذیرد و تمامی محاسبات در هنگام دستهبندی انجام میگردند.

lاز این رو برای کاهش زمان دستهبندی از تکنیکهای ایندکس استفاده میشود.

lدر اغلب روشهای IBL برای بازیابی مثالهای مشابه از حافظه از تمامی ویژگیهای موجود استفاده میشود. بنابراین اگر تابع هدف فقط به برخی از ویژگیها بستگی داشته باشد، مثالهائی که واقعا مشابه هستند ممکن است بسیار از یکدیگر دور شوند.

اسلاید 5 :

مثالیازکاربردها

برای هر تصویر با استفاده از مقادیر پیکسلهای آن یک signature محاسبه شده و از آن برای مقایسه تصویر ورودی با تصاویر موجود در پایگاه داده استفاده میشود.

اسلاید 6 :

limage size: 82x100 pixels

leach pixel is associated with 36(=(1+8)x4) features

l5NN is used for prediction

lerror rate is about 9.5%

l5NN performs best among LVQ, CART, NN, … .

اسلاید 7 :

lK-Nearest neighbor (k-NN)

lDiscrete Target Functions

lContinuous Target Functions

lDistance Weighted

lLocally weighted regression

lRadial basis function networks

lCase-based reasoning

lGeneral Regression Neural Networks

اسلاید 8 :

lk-NN سادهترین و متداولترین روش مبتنی بر یادگیری نمونه است.

lدر این روش فرض میشود که تمام نمونهها نقاطی در فضای n بعدی حقیقی هستند و همسایهها بر مبنای فواصل اقلیدسی استاندارد تعیین میشوند.

lمراد از k تعداد همسایههای در نظر گرفته شده است.

اسلاید 9 :

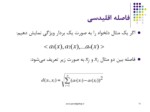

فاصلهاقلیدسی

lاگر یک مثال دلخواه را به صورت یک بردار ویژگی نمایش دهیم:

lفاصله بین دو مثال xi و xj به صورت زیر تعریف میشود:

اسلاید 10 :

برای یک تابع هدف گسسته به صورت

الگوریتم k-NN به صورت زیر است:

الگوریتم یادگیری

lهر مثال آموزشی < x , f(x) >را به لیست training_examples اضافه کنید.

الگوریتمدستهبندی :

lبراینمونهموردبررسی : xq

lنزدیکتریننمونههائیازtraining_examplesبهآنرابا x1…xkنمایشدهید.

lمقدارزیررامحاسبهنمودهوبرگردانید.